Oxford Üniversitesi’nden bilim insanları, yapay zeka ve ileride oluşturacağı tehlike konusunda uyarılarda bulundu. Otonom silahlar, sosyal manipülasyon ve bizim yerimize karar veren makineler, Mahremiyetin ihlali ve sosyal derecelendirme, hedeflerimiz ile makinenin hedefleri arasındaki uyumsuzluk… İşte detaylar…

Yapay zeka, günümüzde son hızla yaygınlaşmaya devam ederken oluşturacağı tehlikeler göz ardı edilmiyor. Yapay zekanın insan tarafından üretilmesi fakat aynı zamanda insanüstü sayılması birçok tehlikeyi de beraberinde getiriyor.

Oxford Üniversitesi’ndeki araştırmacılar, yapay zeka ve ilerde oluşturacağı tehlike için açıklamalarda bulundu. Peki bilim insanları, yapay zeka ve muhtemel tehlike için neler söyledi? Haberin detaylarına hep birlikte göz atalım.

Yapay Zeka, ABD ve Çin arasında büyük bir silahlanma yarışına start verdi

Oxford Üniversitesi’nden Makine Profesörü Michael Osborne, yapay zeka ve ileride oluşturacağı muhtemel tehlike için açıklama yaptı. Bu açıklamada makine profesörü, Amerika ve Çin arasında yapay zeka alanında büyük bir silahlanma yarışı olduğundan bahsetti.

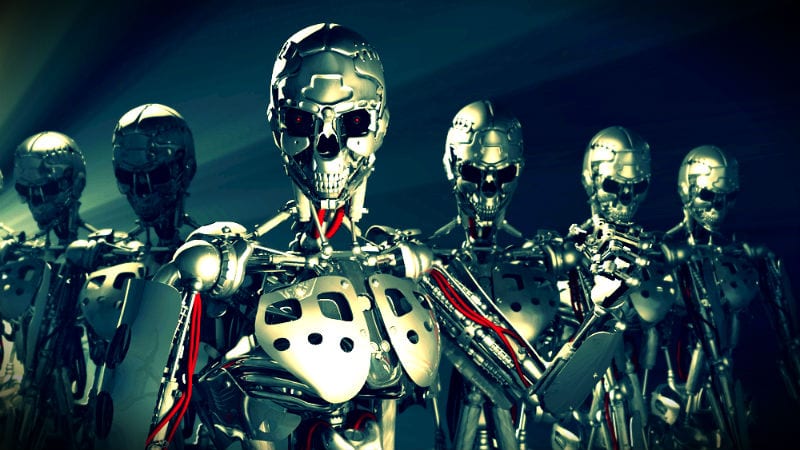

Otonom silahlar

Öldürmeye programlanmış otonom silahlarda olduğu gibi, tehlikeli bir şey yapmaya programlanmış bir yapay zeka, insanlar için ölümcül risk oluşturabilmesinin bir yoludur. Hatta nükleer silahlanma yarışının yerini küresel bir otonom silahlanma yarışına bırakmasını beklemek sürpriz olmayacak.

Putin: Kim bu alanda lider olursa, dünyanın hükümdarı olur

Rusya Devlet Başkanı Vladimir Putin bu konuda yaptığı açıklamada, “Yapay zeka sadece Rusya için değil, tüm insanlık için gelecek. Muazzam fırsatlarla birlikte gelir, ancak aynı zamanda tahmin edilmesi zor tehditler de vardır. Kim bu alanda lider olursa, dünyanın hükümdarı olur.”

Otonom silahların “kendi akıllarına” sahip olabileceği endişesinin yanı sıra, daha yakın bir endişe, otonom silahların insan hayatına değer vermeyen bir birey veya hükümet karşısında sahip olabileceği tehlikelerdir. Bir kez yerleştirildikten sonra, onları sökmek veya savaşmak muhtemelen zor olacaktır.

Osberne, ek olarak yapay zekanın kullanımının yanlış kişilerin eline geçtiği durumda ölümcül olabileceğini de açıkladı. Hatta bu alanda en çok yapay zekayı geliştirenin yani insanın tehlikede olduğunu belirtti.

Oxford Üniversitesi’nden doktora öğrencisi Michael Cohen ise yapay zeka ile ilgili şu sözleri aktardı: “Bir köpeği ödüllerle eğittiğinizi hayal ederseniz ödül almasına yol açan eylemleri seçmeyi öğrenecektir. Ancak köpek, ödül dolabını bulursa yapmasını istediğimiz şeyi yapmadan ödülleri kendisi alabilir.”

Öte yandan Profesör Michael Osberne ve Michael Cohen, yaptıkları araştırmalarda yapay zekanın 100 yıl sonra artacağını ve doğru düzenlemeler uygulandığı takdirde tehlike oluşturmayacağı ve önüne geçileceğini açıkladılar.

Yapay zeka nasıl tehlikeli olabilir?

Efsanevi fizikçi Stephen Hawking ve Tesla ve SpaceX lideri ve yenilikçi Elon Musk gibi bazı önemli kişiler, yapay zekanın potansiyel olarak çok tehlikeli olabileceğini öne sürüyor; Musk bir noktada yapay zekayı Kuzey Kore diktatörünün tehlikeleriyle karşılaştırıyordu. Microsoft’un kurucu ortağı Bill Gates de temkinli olmak için neden olduğuna, ancak doğru yönetilirse iyinin kötüden daha ağır basabileceğine inanıyor. Son gelişmeler, süper zeki makineleri başlangıçta düşünülenden çok daha erken mümkün kıldığı için, şimdi yapay zekanın hangi tehlikeleri oluşturduğunu belirlemenin zamanı geldi.

Fütürist Bernard Marr, “Yapay Zeka Tehlikeli mi? Herkesin Bilmesi Gereken AI Riskleri” başlıklı yazısında şu ifadelere yer verdi:

Henüz süper zeki makineler elde etmemiş olsak da, yasal, politik, toplumsal, finansal ve düzenleyici konular o kadar karmaşık ve geniş kapsamlı ki, gerektiğinde aralarında güvenli bir şekilde çalışmaya hazır olmak için onları şimdi yeniden gözden geçirmemiz gerekiyor. Yapay zeka, şimdi süper zeki makinelerle bir geleceğe hazırlanmanın yanı sıra, mevcut haliyle şimdiden tehlike oluşturabilir nitelikte.

Sosyal manipülasyon: Bizim yerimize karar veren makineler

Otonom çalışan algoritmaları aracılığıyla sosyal medya, hedef pazarlamada çok etkili bir araç haline geldi. Kim olduğumuzu, nelerden hoşlandığımızı biliyorlar ve ne düşündüğümüzü tahmin etmekte inanılmaz derecede iyiler. 2016 ABD Başkanlık seçimlerinin ve Birleşik Krallık’ın Brexit referandumunun sonucunu etkilemeye çalışmak için 50 milyon Facebook kullanıcısından alınan verileri kullanan Cambridge Analytica ve şirketle ilişkili diğer kişilerin hatasını belirlemek için soruşturmalar halen devam ediyor. Bu iddialar doğruysa, bu aslında yapay zekanın sosyal manipülasyon gücünü gösterir. Algoritmalar ve kişisel veriler aracılığıyla tanımlanan bireylere propaganda yayarak, onları hedefler ve istedikleri bilgiyi, en inandırıcı bulacakları formatta (gerçek veya kurgu) yayabilir.

Mahremiyetin ihlali ve sosyal derecelendirme

Artık bir bireyin çevrimiçi olarak her hareketini ve günlük işlerini yaparken takip ve analiz etmek mümkün. Kameralar neredeyse her yerde ve yüz tanıma algoritmaları kim olduğunuzu biliyor. Aslında bu, Çin’in 1,4 milyar vatandaşının her birine nasıl davrandıklarına göre kişisel bir puan vermesi beklenen sosyal kredi sistemine güç verecek bilgi türüdür.

Sosyal Skor olarak adlandırılan ve Black Mirror dizisine de konu olan bu sistem; kırmızı ışıkta geçenlerden, sigara içilmeyen alanlara; video oyunları oynamak için insanların ne kadar zaman harcadıklarına kadar tüm davranışlarını gözlemleyerek vatandaşlık puanı veren bir sistem niteliğinde. Big Brother sizi izlediğinde ve ardından bu istihbarata dayalı olarak kararlar verdiğinde, bu yalnızca bir mahremiyet ihlali değil, hızla sosyal baskıya dönüşebilir.

Suç işlemeden suçluyu tespit etmek

Hatta son dönemde işlenecek suçun, daha suç işlenmeden önce yapay zeka tarafından tespit edilebilmesi konusunda çalışmalar yürütülüyor. Chicago Üniversitesi’nden Tıp Doçenti ve Nature Human Behavior bülteninde yayımlanan makalenin kıdemli yazarı Ishanu Chattopadyay, konuyu şöyle aktarıyor:

“Sistemi zorladığınız zaman, zengin muhitte işlenen suça cevaben daha fazla kişiyi tutuklamanın daha fazla kaynak gerektirdiğini ve polis kaynaklarının daha düşük sosyoekonomik statüye sahip alanlardan çekilmesine sebep olduğunu gördük.”

Hedeflerimiz ile makinenin hedefleri arasındaki uyumsuzluk

Yapay zeka ile çalışan makinelerde insanların değer verdiği şeylerden biri de verimlilikleri ve etkinlikleridir. Ancak yapay zeka makineleri için belirlediğimiz hedefler konusunda net değilsek, bir makinenin bizim sahip olduğumuz aynı hedeflerle donatılmaması tehlikeli olabilir. Nasıl mı?

Örneğin, “Beni olabildiğince çabuk havaalanına götür” komutunun korkunç sonuçları olabilir. İnsan hayatına değer verdiğimiz için yol kurallarına uyulması gerektiğini belirtmeden, bir makine sizi mümkün olan en kısa sürede havaalanına götürme hedefini oldukça etkili bir şekilde gerçekleştirebilir ve tam anlamıyla istediğinizi yapabilir, ancak arkasında bir kaza izi bırakabilir. Belki de aracınız havalimanına vardığında siz ve trafikteki başka insanlar hayatta bile olmayabilir.

Ayrımcılık

Makineler hakkınızda çok fazla bilgi toplayabildiği, izleyebildiği ve analiz edebildiği için, bu makinelerin bu bilgileri size karşı kullanması oldukça olasıdır. Bir sigorta şirketinin, telefonunuzda konuşurken kameraya yakalanma sayısına dayanarak size sigortalı olmadığınızı söylediğini hayal etmek zor değil. Bir işveren, “sosyal kredi puanınıza” dayalı olarak bir iş teklifini geri çekebilir. Bu algoritmalar büyük sigorta şirketlerinde hali hazırda uygulanmaya başladı bile.

Herhangi bir güçlü teknoloji kötüye kullanılabilir. Günümüzde yapay zeka, daha iyi tıbbi teşhisler koymamıza, kanseri tedavi etmenin yeni yollarını bulmamıza ve arabalarımızı daha güvenli hale getirmemize yardımcı olmak da dahil olmak üzere birçok iyi amaç için kullanılmaktadır. Ne yazık ki, AI yeteneklerimiz genişledikçe, onun tehlikeli veya kötü amaçlar için kullanıldığını da göreceğiz. Yapay zeka teknolojisi çok hızlı ilerlediğinden, yapay zekanın yıkıcı potansiyelini en aza indirirken olumlu yönde gelişmesinin en iyi yollarını tartışmaya başlamak bizim için hayati önem taşıyor.